AI奇点网2023年7月26日报道丨谷歌近日发布了名为 Brain2Music 的论文,可以利用人工智能读取、分析你的功能性磁共振成像(fMRI)数据,然后再基于你的大脑活动自动生成音乐。

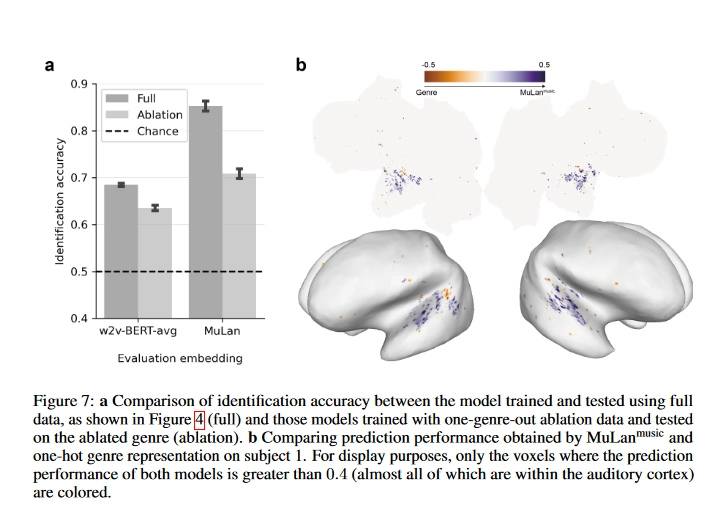

研究人员招募了 5 名志愿者,先让其听蓝调,古典,乡村,迪斯科,嘻哈,爵士乐,金属,流行,雷鬼和摇滚等不同音乐类型的 15 秒音乐片段,然后记录志愿者的 fMRI 数据。谷歌使用这些数据训练出一个深度神经网络,以了解大脑活动模式与音乐节奏和情感等不同元素之间的关系。

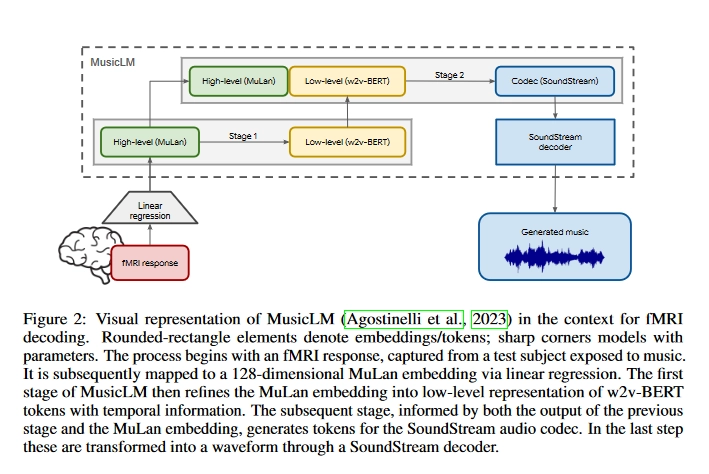

Brain2Music 基于谷歌此前推出的 MusicLM 模型(基于文本生成音乐片段),基于 fMRI 生成 15 秒音乐片段。研究结果显示 Brain2Music 生成的 15 秒音乐片段,其中一段内容“Oops!...I Did It Again”和测试听到的原版音乐基本相同。

喜欢

喜欢 顶

顶 无聊

无聊 围观

围观 囧

囧 难过

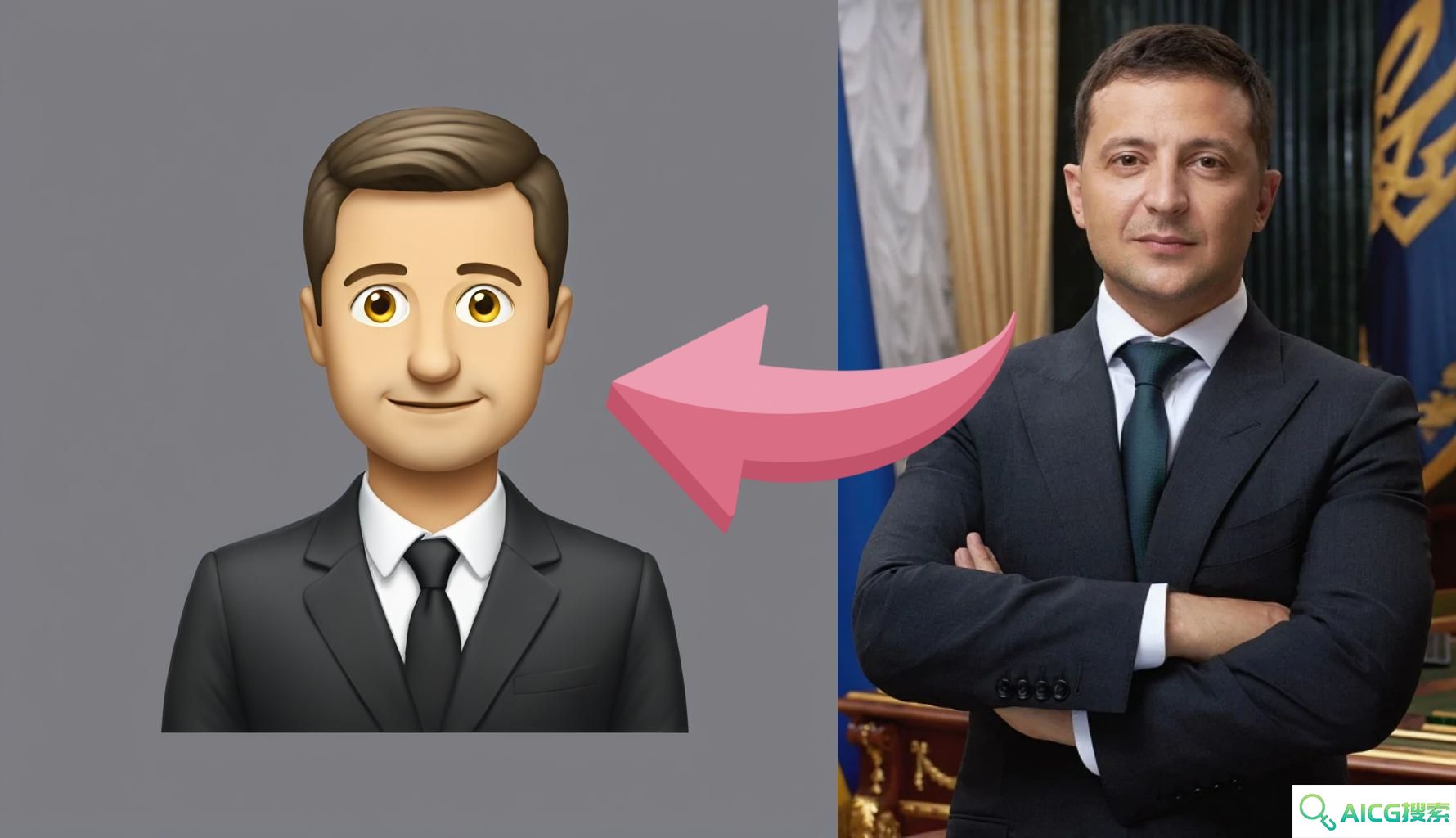

难过 免费超好用_AI Emoji头像生成器:10秒生成_个性不重样

免费超好用_AI Emoji头像生成器:10秒生成_个性不重样

AI视频后期消除对象神器ProPainter:一涂一抹,视频轻松移除指定对象丨本地离线一键部署

AI视频后期消除对象神器ProPainter:一涂一抹,视频轻松移除指定对象丨本地离线一键部署

Runway Gen-2史诗级版本更新实测:我宣布,AI视频迎来「iPhone时刻」

Runway Gen-2史诗级版本更新实测:我宣布,AI视频迎来「iPhone时刻」

特斯拉机器人发布会“擎天柱”背后有人远程操控丨李开复:零一万物没有放弃训练大模型丨快手推出开源文生视频模型

特斯拉机器人发布会“擎天柱”背后有人远程操控丨李开复:零一万物没有放弃训练大模型丨快手推出开源文生视频模型

阿里寻光_寻光视频创作平台_寻光视频创作官方网站

阿里寻光_寻光视频创作平台_寻光视频创作官方网站

李彦宏官宣:目前有10%的百度「大搜流量」经由文心一言大模型生成

李彦宏官宣:目前有10%的百度「大搜流量」经由文心一言大模型生成

苹果M4芯片首发!史上最薄iPad,丝滑4K剪片:苹果发布地表最强AI硬件iPad Pro 2024款

苹果M4芯片首发!史上最薄iPad,丝滑4K剪片:苹果发布地表最强AI硬件iPad Pro 2024款